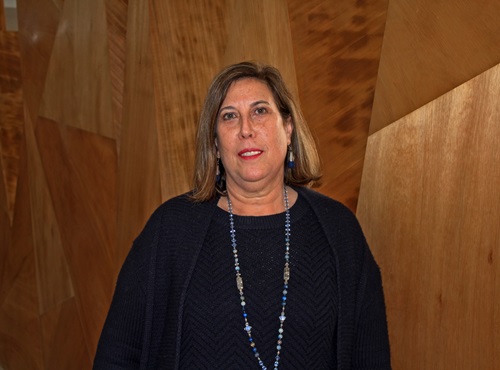

Paulina Fernández

Directora de abogacía y estudios Aldeas Infantiles SOS .

Pronto a conmemorarse el Día Internacional de la Lucha Contra el Maltrato Infantil (25 de abril), vale la pena reflexionar acerca de los desafíos éticos y de protección que enfrentan los niños, niñas, adolescentes y jóvenes (NNAJ) relativos a los potenciales riesgos a los que se pueden ver expuestos a través de las nuevas tecnologías, específicamente mediante la Inteligencia Artificial (I.A.).

Hoy es una realidad que una de las manifestaciones del maltrato y abuso sexual contra NNAJ que ha crecido de manera exponencial está relacionada con la violencia on-line. Esto ocurre a través del uso cotidiano de tecnologías de información y comunicación, las que además de usarse como plataformas para establecer relaciones sociales, también son escenario propicio para que el anonimato pase a ser cómplice de eventuales situaciones de abusos. El tipo de violencia que ocurre en estos entornos digitales, al igual que la violencia ejercida presencialmente, afecta negativa e indiscutiblemente el desarrollo y bienestar de los niños y niñas.

Estudios realizados en este ámbito evidencian que así como la I.A. está aportando a la prevención y detección de patrones de comportamiento asociados especialmente en el ámbito del abuso sexual infantil (dada su capacidad de analizar grandes volúmenes de datos), también es cierto que esta misma tecnología ha simplificado drásticamente la creación de imágenes de niños explotados o abusados, ya sean reales o falsas, siendo una forma de violencia a la que NNAJ ya se ven expuestos, y que se incrementará significativamente gracias a los avances que día a día adquiere esta poderosa herramienta.

Si bien ya han sido conocidos casos de celebridades mundiales vulneradas con la creación de este tipo de imágenes y videos falsos generados con I.A., de menor manera se habla de cómo también se está exponiendo a NNAJ con la difusión masiva e incontrolable a través de estas tecnologías. Hoy con sólo ingresar una simple instrucción en alguna de las plataformas de I.A. disponibles gratuitamente a todo el mundo, es posible obtener imágenes, audios, textos y videos de niños y niñas reales con imágenes falseadas que los exponen a la violación de su privacidad, integridad física y emocional.

Esta problemática social ya se identifica como causante de un profundo riesgo de vulneración de derechos humanos a nivel global. Lo que se profundiza aún más dado que las investigaciones de delitos relativos a difusión de material audiovisual de menores de edad hacen imposible detectar con precisión qué imágenes son reales o cuáles falsas, vulnerando y exponiendo en el proceso a miles de NNAJ víctimas de los avances de esta tecnología.

Chile cuenta desde 2021 con una política pública referida a I.A. Recientemente incluso el país fue destacado en el primer lugar (CENIA 2023) como referente regional latinoamericano en todo lo relativo a la I.A., tanto por infraestructura, programas avanzados de estudios y un robusto ecosistema científico de expertos en la materia. La Cámara de Diputados aprobó a comienzos de este año la idea de legislar en torno a materias de control relativos a I.A. Al parecer como país nos podríamos encontrar en buen pie para ser ejemplo y adelantarnos a este riesgo que se aproxima a pasos agigantados.

El maltrato infantil tiene múltiples expresiones, causas, fuentes y contextos de los cuales hacerse cargo. Procurar que el uso de la Inteligencia Artificial (I.A.) cuente con una apropiada regulación respetando los derechos y la dignidad de NNAJ no sólo parece de sentido común, sino que una tarea crucial si queremos resguardar integralmente su bienestar. Ocuparnos seria y responsablemente hoy, podría prevenir graves vulneraciones y daños a los niños y niñas mañana.